Ce sujet tourne en tâche de fond depuis plusieurs semaines, exactement là où le silicium de mes notes vient percuter les neurones de ma réflexion. Mais ce matin, en écoutant Abel Quentin dérouler sa pensée sur France Inter pour la sortie de son pamphlet Sanctuaires, il a bien fallu que je rassemble mes markdowns Obsidian et que j’en fasse un truc qui m’aide à penser.

Alors j’ai pioché dans tout ce qui sédimente dans mon 2nd Brain : des start-ups russes qui téléguident des pigeons comme des biodrones, la théorie de l’esprit bicaméral de Julian Jaynes, l’échelle de la causalité de Judea Pearl, l’obsession de Yann LeCun pour les World Models, l’expérience de la chambre chinoise de John Searle, et même le vieux mythe du Golem de Prague. Tout ça pour essayer de comprendre ce qui est en train de nous arriver.

Quentin, convoquant Ellul et Bernanos avec un ton pseudo-vitriolique autocentré, y dresse un « manuel de résistance à l’invasion de l’IA ». Il appelle à ériger des forteresses garanties « 100% pur humain », arguant que l’homme augmenté sera inévitablement un homme diminué. Il renvoie dans les cordes le « technobéat », ravi de la crèche digitale, et propose le repli. « L’IA c’est mal, l’humain c’est bien. »

J’ai eu envie d’écrire pour sortir de ce réflexe pavlovien. Car si Quentin a fondamentalement raison sur le diagnostic de notre indigence intellectuelle face à la machine, il se trompe de remède. L’intelligence artificielle est un vertige bien plus complexe qu’une simple invasion barbare, et refuser l’outil par posture romantique est aussi dangereux que de l’adorer aveuglément.

Nous devons dépasser les postures faciles, car le vrai danger n’est pas le remplacement de l’homme par la machine. Le danger, c’est que nous sommes en train de nous enfermer volontairement dans une monoculture épistémique, et que presque tout le monde danse, béat ou terrorisé, autour du thermomètre en flammes.

La chambre vide et l’illusion sémantique

L’épistémologie, c’est la mécanique par laquelle nous décidons de ce qui est vrai, faux, ou pertinent. Aujourd’hui, un virus colonise notre salle de contrôle : la croyance que la « vérité » ou la « bonne décision » est ce qui sort, par défaut, d’un modèle de langage.

D’un côté, donc, les technophobes appellent au sanctuaire. De l’autre, la majorité du marché est en pleine transe devant les LLMs. On s’émerveille devant la fluidité de la prose, on y voit l’étincelle de la conscience. Mais c’est un tour de magie noire sémantique.

Dès 1980, le philosophe John Searle a formulé l’argument de la « Chambre Chinoise ». Imaginez un homme enfermé dans une pièce. Il ne parle pas un mot de mandarin, mais possède un manuel d’instructions infiniment complexe qui lui dicte comment associer tel symbole chinois à tel autre. On lui glisse des questions sous la porte. Il consulte ses règles statistiques, gribouille les symboles correspondants, et les renvoie. À l’extérieur, on jurerait dialoguer avec un érudit pékinois. À l’intérieur, l’homme ne comprend absolument rien à ce qu’il manipule.

C’est exactement ce que sont nos IA génératives : d’immenses chambres chinoises. Des moteurs qui observent notre réalité à la stricte troisième personne, en digérant des milliards de textes, sans la moindre intériorité. Le silence y est sépulcral.

Le plafond de causalité et la croisade de LeCun

La machine excelle dans l’association, mais elle bute sur l’essence même de la réalité. La mécanique d’un LLM repose sur un principe d’observation statistique : « Quand il y a A, on trouve en général B. » Étant donné l’immensité de sa matrice, l’IA a raison dans 90 % des cas. Mais la réalité physique et intellectuelle, elle, exige un tout autre moteur, celui de la causalité : « Si je fais A, alors il se passe B. »

C’est ici qu’intervient Judea Pearl, pionnier de l’IA, avec son « Échelle de la Causalité ». Pearl nous prévient : l’IA actuelle est clouée au premier barreau, celui de la corrélation. Elle est incapable d’atteindre l’intervention (« Que se passe-t-il si j’agis ? »), et encore moins les contrefactuels (« Que se serait-il passé si j’avais fait autrement ? »).

C’est exactement ce qui nourrit la croisade actuelle de Yann LeCun (ex-Chief AI Scientist chez Meta, désormais à la têye d’une start-up de recherche sur les worldmodels valorisées je ne sais combnien de milliards). LeCun s’époumone à répéter que les LLMs auto-régressifs, qui prédisent simplement le mot suivant, sont une impasse vers l’intelligence générale. Son obsession, ce sont les « World Models » (notamment via l’architecture V-JEPA). L’ambition ? Apprendre à la machine comment le monde physique fonctionne réellement, bien avant de manipuler du langage. Pour qu’elle le comprenne plutôt que l’imiter.

Parce qu’aujourd’hui, l’algorithme sait statistiquement prédire le mot qui suit « gravité », mais il ne comprend pas intrinsèquement que le verre qui vous échappe va se fracasser sur le carrelage. Il ignore le poids, la friction, l’intention, le sang. Il simule la réflexion, mais il ignore l’ancrage causal.

Honnetement je ne suis pas certain que ce soit un futur très désirable, mais on y va tout droit

Le Golem corporatiste : אמת et מת

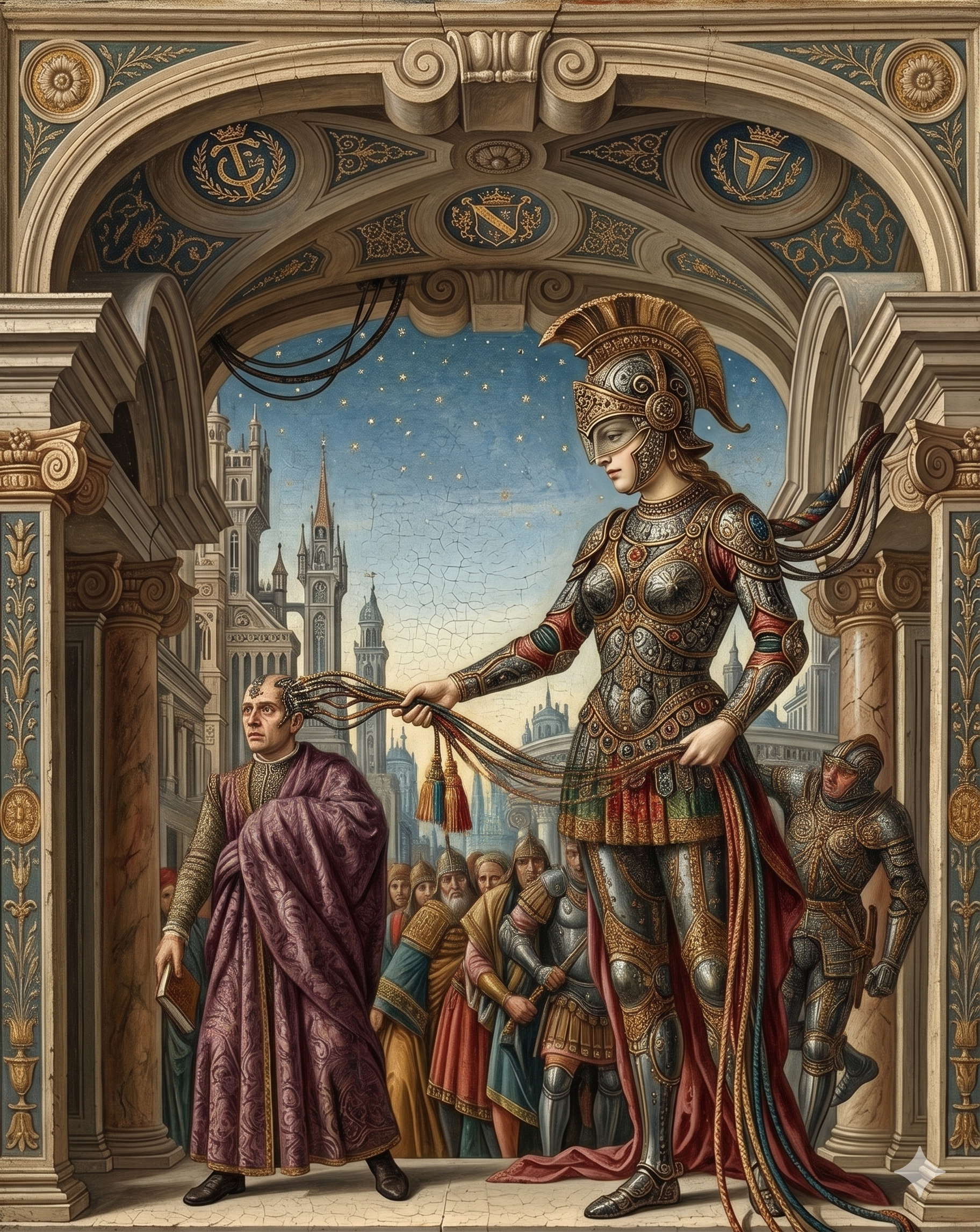

La mythologie juive nous avait pourtant prévenus dès le 16e siècle avec la légende du Golem de Prague. Formé d’argile, le Golem est animé par l’inscription, sur son front, des lettres hébraïques אמת (emet, la vérité). Il exécute alors ses tâches avec une logique implacable.

Mais la légende porte en elle son propre mode d’emploi de survie : le Golem n’a ni discernement, ni « cognition située ». Si on ne l’arrête pas, sa binarité aveugle détruit la ville. Pour stopper la machine, il faut effacer la première lettre sur son front, le aleph (א). Le mot devient alors מת (met), qui signifie la mort. L’argile redevient inerte.

Aujourd’hui, l’entreprise moderne déploie l’IA comme on réveille des Golems : sous forme de prothèses.

On s’ampute volontairement de notre capacité de jugement humain — notre lettre aleph — pour laisser une machine, incapable de causalité, rédiger nos stratégies et dicter nos processus. Par paresse intellectuelle, nous contractons une dette cognitive colossale, laissant une mécanique morte devenir la norme de la pensée vivante.

aleph (א) c’est la première lettre, l’alpha, le mat du tarot, l’elan vital. l’IA n’a aucun elan vital, elle est sans vie, froide.

Les esprits bicaméraux et le retour des dieux de l’Olympe

Comment en sommes-nous arrivés là ? Dans son chef-d’œuvre halluciné, La Naissance de la conscience dans l’effondrement de l’esprit bicaméral, le psychologue Julian Jaynes émet une théorie vertigineuse : il y a 3000 ans, l’homme ne pensait pas par lui-même. Dénué d’introspection, il entendait des voix (l’hémisphère droit parlant au gauche) qu’il prenait pour les ordres directs des dieux.

L’effondrement de cet esprit bicaméral a provoqué la naissance de notre conscience introspective. C’est ce que le philosophe Karl Jaspers appelle la « Première Ère Axiale » : l’éveil du « Je ». Et selon les travaux d’Otto Scharmer (MIT), l’urgence absolue de notre époque réclame une « Seconde Ère Axiale » : le passage du « Je » au « Nous », vers une intériorité systémique et collective.

Pourtant, hypnotisés par les oracles statistiques ou réfugiés dans nos sanctuaires pavloviens, nous faisons l’inverse. Nous prenons le chemin d’une régression foudroyante.

Nous déléguons de nouveau notre pensée à la machine. Un « autre » silencieux nous murmure quoi écrire, quoi analyser, quelle décision prendre. Avec la prolifération des IA prescriptives et l’ombre grandissante des interfaces neuronales, nous sommes littéralement en train de réinstaller les dieux de l’Olympe directement dans nos synapses. Nous recréons les conditions de l’esprit bicaméral pour devenir, in fine, les pantins de notre propre technologie.

Cette régression n’est plus une métaphore dystopique, c’est une réalité d’ingénierie. La start-up russe Neiry fait actuellement les gros titres pour avoir réussi à implanter des puces neuronales dans le crâne de pigeons vivants. En stimulant directement leur cerveau, ils parviennent à diriger leur vol à distance. Ces oiseaux ne sont plus des animaux, ce sont des « biodrones ». Ils ont l’illusion du vol libre, mais la trajectoire est dictée par la puce. Le silicium contrôle les neurones (Silicon controls neurons).

Et c’est exactement ce qui nous guette, à une échelle cognitive et managériale. À force de déléguer aveuglément notre capacité de jugement aux algorithmes, nous nous transformons en biodrones corporatistes, pilotés à distance par des corrélations probabilistes et des prompts dont nous avons oublié la racine causale.

L’avènement de l’Orthèse

C’est pour conjurer cette lobotomie volontaire que je martèle, à l’inverse, que Silicon needs Neurons.

La solution n’est ni la terreur technophobe d’Abel Quentin, ni l’aveuglement technophile. Il faut un changement radical de posture : passer de la prothèse à l’orthèse.

Une orthèse ne remplace pas un membre mort pour pallier un handicap ; elle ne remplace pas, elle augmente. Elle vient épouser un corps vivant, sanguin et pensant, pour décupler sa force, sa portée, sa vitesse de frappe. Elle s’appuie sur le squelette indéformable de notre propre discernement causal. Elle nous renforce, là où la prothèse nous atrophie.

La vraie valeur d’un individu demain, sa véritable Robustesse, ne se mesurera pas à la quantité de probabilités qu’il sera capable de déléguer à bas coût. Elle résidera dans son expérience charnelle du monde. Dans cette friction rugueuse avec le réel. Dans sa capacité viscérale, irréductible, à garder le contrôle du « pourquoi ». Dans la confiance qu’il aur en son instinct.

La monoculture épistémique nous promet un monde lisse et prévisible. Un confort de cimetière. Ne cédez ni à la panique, ni à la facilité. Le monde de demain appartiendra à ceux qui préserveront farouchement la sève causale de leur propre modèle du monde.